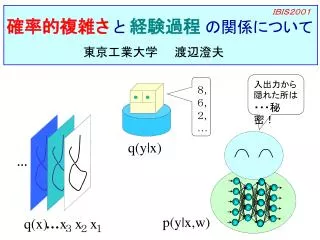

確率的複雑さ と 経験過程 の関係について

IBIS2001. 確率的複雑さ と 経験過程 の関係について. 東京工業大学 渡辺澄夫. 入出力から 隠れた所は ・・・秘密!. 8, 6, 2 , …. q(y|x). …. p(y|x,w). …. q(x). x. x. x. 3 . 2 . 1. X 1 , X 2 , …, X n 例 ~ q(x) : 真の分布 p(x|w) : 学習モデル ( w ∈ W : コンパクト ). カルバック距離. q(x) p(x|w). H(w) = ∫ q(x) log dx. 経験距離.

確率的複雑さ と 経験過程 の関係について

E N D

Presentation Transcript

IBIS2001 確率的複雑さと 経験過程の関係について 東京工業大学 渡辺澄夫 入出力から 隠れた所は ・・・秘密! 8, 6, 2, … q(y|x) … p(y|x,w) … q(x) x x x 3 2 1

X1, X2, …, Xn例 ~q(x) : 真の分布 p(x|w) : 学習モデル (w ∈ W : コンパクト) カルバック距離 q(x) p(x|w) H(w) =∫ q(x) log dx 経験距離 n i=1 q(Xi ) p( Xi | w) 1 n Hn(w) = log Σ

ギブス推測とベイズ推測 事前分布 事後分布 1 Z p(w|Xn) = exp( - n Hn(w)) φ(w) ベイズ推測 p(x|Xn) = ∫ p(x|w) p(w|Xn) dw ギブス推測 p(x|w), w ~ p(w|Xn)

ギブス推測 q(x) p(x|w) Ggibbs (n) = Exn Ew [∫q(x) log dx] ∫H(w)exp (-nHn(w)) dw = Exn [ ] ∫exp (-nHn(w)) dw 汎化誤差 dw = Φ(w)dw ベイズ推測 q(x) p(x|Xn) Gbayes (n) = Exn [ ∫q(x) log dx ] ∫exp ( -(n+1)Hn+1(w) ) dw = - Exn+1 [ log ] ∫exp (-nHn(w)) dw

ギブス,ベイズ推測における数学的問題 n →∞のexp( - n Hn(w) ) φ(w) を解明せよ 超関数として漸近展開せよ 特異点の構造 exp( - n H(w) ) 確率的なゆらぎ H(w) - Hn(w)

0 正の実数 カルバック情報量 H(g(u))=a(u) u1k1 u2k2 … udkd H(w) 特異点解消 g(u) パラメータ空間 W 実多様体 U 特異点解消定理 φ(u) = φ(g(u)) g’(u) φ(w)

√ 正規交差特異点 (0,1]d 上で H(w) = a(w) w12s1w22s2… wd2sd φ(w) = b(w) w1k1w2k2… wdkd 経験過程 Hn(w)-H(w) nH(w) 1 n n i=1 ζn (w) = = Σ r(Xi,w) √ 正規交差特異点では 特異点上に解析的に拡張できる カルバック情報量 n Hn(w) = n H(w) + {nH(w)}1/2 ζn (w)

統計的推測と特異点解消の関係 a + bv 1 + v2 ζ(u,v) = x = u y = uv v ax + by x2 + y2 ζ(x,y) = O u y at + b t2 + 1 x = st y = s ζ(s,t) = s x O O t

経験過程 1 n n i=1 ζn (w) = Σ r(Xi,w) √ ζ(w) = 平均0, 共分散 ∫r(x,w)r(x,w’) q(x) dx W上の正規確率過程 { r(x,w) ;w∈W} が q-Donsker lim Exn { F(ζn)} = E ζ{F(ζ)} n →∞ W がコンパクト, log p(x|w) が w について解析的なら lim Exn { supw |ζn(w)|k} = E ζ{supw |ζ(w)|k} n →∞

超関数の漸近展開 (log n)m-1 nλ exp( - n H(w) ) φ(w) n →∞ D(w) Laplace Transf tλ-1(-log t)m-1 D(w) δ( t – H(w) ) φ(w) t → 0 Mellin Transf D(w) (z+λ)m d j=1 Π wjsj z +kj = H(w)zφ(w)極 超関数値ゼータ関数

事後分布は,どうなってゆくか? exp( - n Hn(w) ) φ(w) = exp[ - n H(w) - {nH(w)}1/2 ζn (w)]φ(w) dt t n n = ∫ー δ( ー - H(w)) φ(w) exp( - t - t1/2 ζn (w) ) tλ-1t nλn = Σ∫dt ー (-log ー )m-1 Dkm(w) exp( - t - t1/2 ζn (w)) k,m = Σ( n により小さくなる項) ×(確率的に揺らぐ項) 経験過程の性質 特異点の性質

ベイズ推測の汎化誤差 ∫exp (-nHn(w)) φ(w) dw tλ-1t nλn = Σ∫dtdw ー (-log ー )m-1 Dkm(w) exp( - t - t1/2ζn (w)) を代入して 分子 n+1 分母 n ∫exp ( -(n+1)Hn+1(w) ) dw Gbayes (n) = - Exn [ log ] ∫exp (-nHn(w)) dw λ 1 n n = ー + o(ー) = λ{ log (n+1) – log n } + small order

ギブス推測の汎化誤差 ∫H(w) exp (-nHn(w)) φ(w) dw tλt nλn = Σ∫dt dw ー (-log ー)m-1Dkm(w) exp( - t - t1/2 ζn (w)) 分母 λ 分子λ-1 を代入して ∫H(w) exp (-nHn(w)) dw Ggibbs (n) = Exn [ ] ∫exp (-nHn(w)) dw t について 部分積分 λ* 1 n n = ー + o(ー) λ< λ*

定理 学習モデルのゼータ関数 J(z) = ∫ H(w)z φ(w) dw の最も原点に近い極を (-λ) とすると λ 1 n n Gbayes (n) = ー + o(ー) λ* 1 n n Ggibbs (n) = ー + o(ー) ここでλ< λ*, λ* は経験過程のある関数の平均

特異モデルの研究展開 G(n) モデルが真を 含まない場合 Neural Networks, to appear. ★ n ★ λは体積次元 V(t) = c tλ 山崎 in this issue G(K) Jeffreys モデル選択 Jeffreys’ Prioir ★ Uniform 西上 in this issue K ★ 具体的モデル MLP G(n)≦ λ1(M,N,H) / n IEEE NN, to appear ★ Guass Mixture の解明 G(n)≦ λ2(M,H) / n 山崎 JNNS, to appear

∞ n=1 1 nz リーマン ゼータ関数 Random Matrices Wigner’s Semi-circle ζ(z) = Σ ー J(z) = ∫H(w)zφ(dw) 学習モデル ゼータ関数 Algebraic geometry Algebraic analysis レプリカ法 ゼータ関数 f(α) = Exn [ Z(Xn)α ] ???